- 首页

- 核心技术

- 产品中心

-

行业应用

-

数智生活

-

数智治理

-

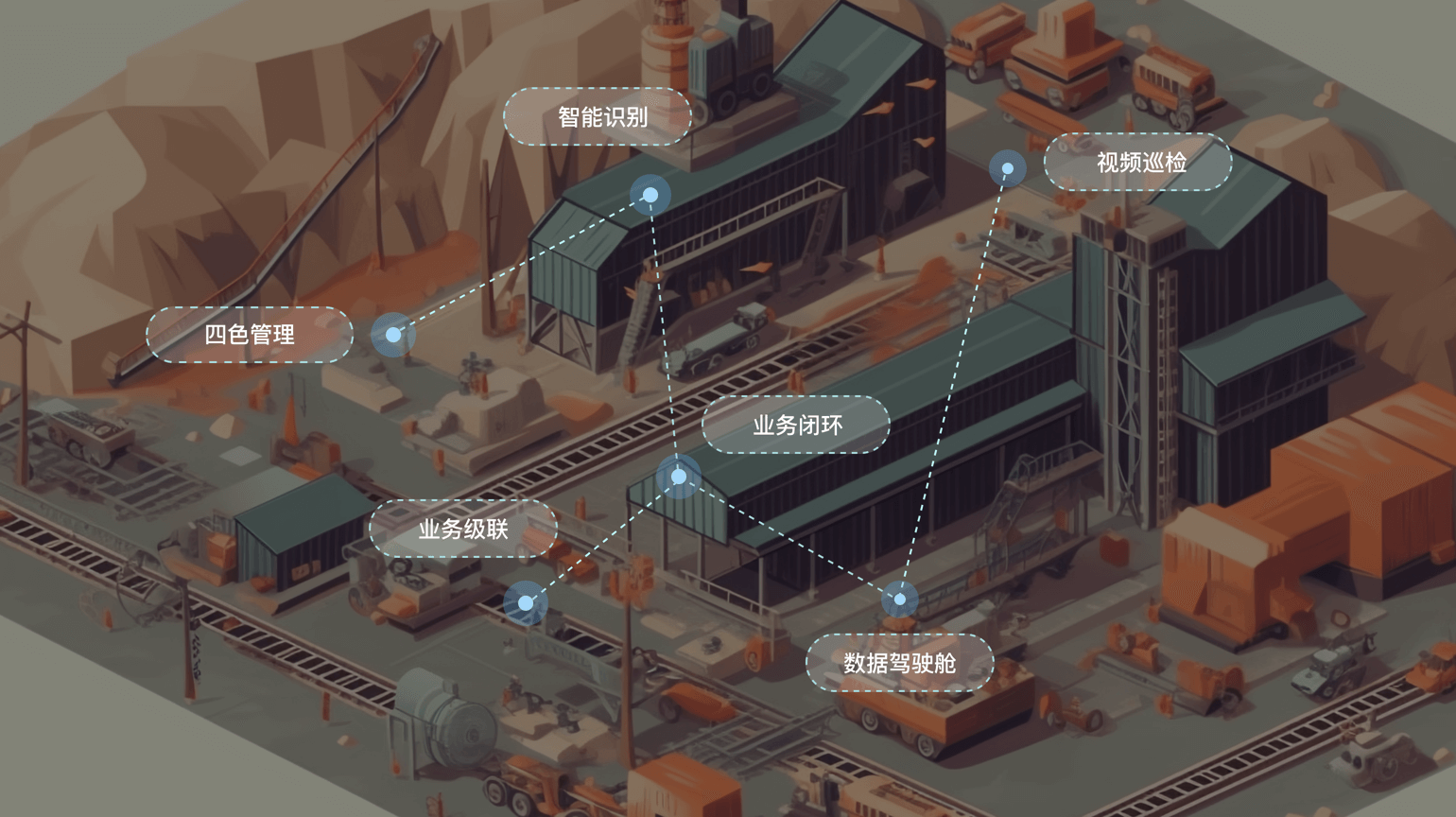

数智产业

-

数智军工

-

- 生态合作

- 新闻中心

- 关于小视

- 开放平台

- Language:EN

应用方案升级中

敬请期待